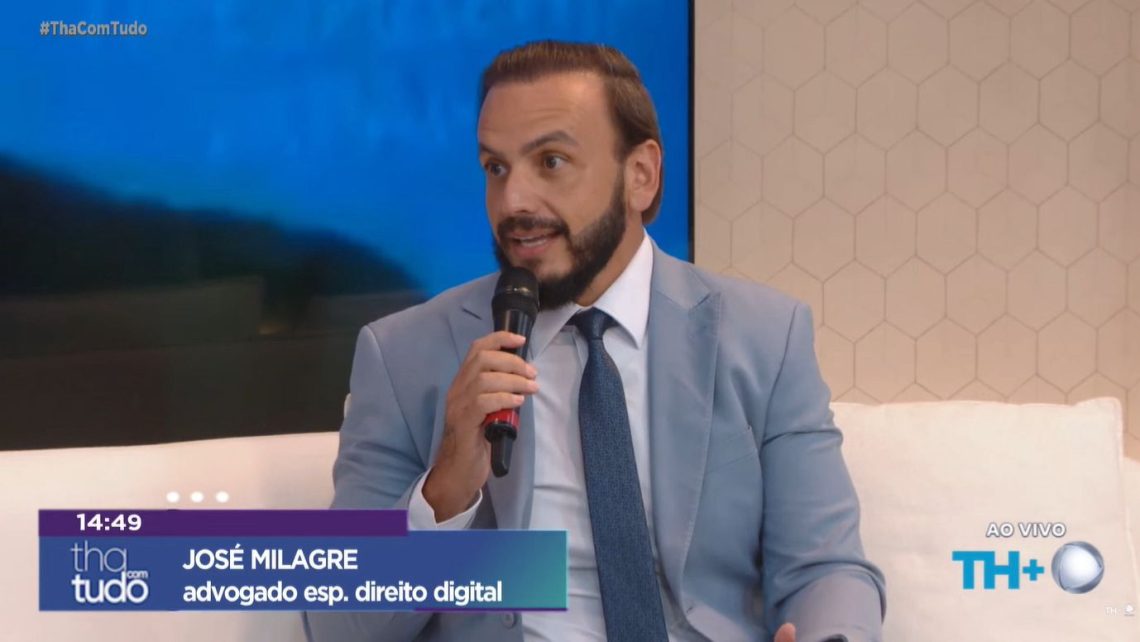

Dr. José Milagre participou do Programa SBT Brasil – crimes sexuais virtuais e detalhes da Lei nº 15.353/2026

O Dr. José Milagre participou do Programa de TV SBT Brasil, comentando os crimes sexuais virtuais e detalhes da Lei nº 15.353/2026 (em vigor desde […]